Ik ben bang. Erg bang.

Internetbrede surveillance en censuur, mogelijk gemaakt door de onvoorstelbaar grote rekenkracht van kunstmatige intelligentie (AI), is een feit.

Dit is geen futuristische dystopie. Het gebeurt nu.

Overheidsinstanties werken samen met universiteiten en non-profitorganisaties om AI-tools te gebruiken om inhoud op internet te monitoren en te censureren.

Dit is niet politiek of partijdig. Het gaat hier niet om een bepaalde mening of idee.

Wat er aan het gebeuren is, is dat er een instrument beschikbaar komt dat krachtig genoeg is om alles wat er op internet wordt gezegd en gedaan (of grote delen ervan) te monitoren, beschikbaar komt voor de overheid om ons allemaal voortdurend in de gaten te houden. En op basis van dat toezicht kan de overheid – en elke organisatie of onderneming waarmee de overheid samenwerkt – hetzelfde instrument gebruiken om elke toespraak die haar niet bevalt te onderdrukken, het zwijgen op te leggen en te stoppen.

Maar dat is niet alles. Met hetzelfde instrument kunnen de overheid en haar publiek-private, ‘niet-gouvernementele’ partners (denk bijvoorbeeld aan de Wereldgezondheidsorganisatie of Monsanto) ook elke activiteit stopzetten die aan het internet is gekoppeld. Bankieren, kopen, verkopen, lesgeven, leren, entertainen, met elkaar in contact komen – als de door de overheid gecontroleerde AI het niet leuk vindt wat u (of uw kinderen!) in een tweet of e-mail zegt, kan het dat allemaal voor een tijdje stopzetten. Jij.

Ja, we hebben dit op zeer lokale en gepolitiseerde schaal gezien, bijvoorbeeld de Canadese vrachtwagenchauffeurs.

Maar als we dachten dat dit soort activiteiten niet op nationale (of zelfs engere – mondiale) schaal zou kunnen of willen plaatsvinden, moeten we nu wakker worden en beseffen dat het gebeurt, en dat het misschien niet meer te stoppen is.

Nieuwe documenten tonen aan dat door de overheid gefinancierde AI bedoeld is voor online censuur

De Amerikaanse House Select Subcommittee on the Weaponization of the Federal Government werd in januari 2023 opgericht “om zaken te onderzoeken die verband houden met het verzamelen, analyseren, verspreiden en gebruiken van informatie over Amerikaanse burgers door uitvoerende instanties, inclusief de vraag of dergelijke inspanningen illegaal, ongrondwettelijk of anderszins onethisch zijn.”

Helaas wordt het werk van de commissie, zelfs door haar eigen leden, gezien als grotendeels politiek: conservatieve wetgevers onderzoeken wat zij beschouwen als het tot zwijgen brengen van conservatieve stemmen door liberaal georiënteerde overheidsinstanties.

Niettemin heeft deze commissie in haar onderzoek enkele verbazingwekkende documenten blootgelegd die verband houden met pogingen van de overheid om de uitspraken van Amerikaanse burgers te censureren.

Deze documenten hebben cruciale en angstaanjagende implicaties voor de hele samenleving.

In het tussentijds rapport van de subcommissie staat gedateerd 5 februari 2024Uit documenten blijkt dat academische en non-profitorganisaties een overheidsinstantie een plan voorleggen om AI-‘misinformatiediensten’ te gebruiken om inhoud op internetplatforms te censureren.

Concreet legt de Universiteit van Michigan aan de National Science Foundation (NSF) uit dat de door AI gefinancierde tools die door de NSF worden gefinancierd, kunnen worden gebruikt om sociale-mediaplatforms te helpen censuuractiviteiten uit te voeren zonder daadwerkelijk te hoeven beslissen over wat er moet worden gecensureerd.

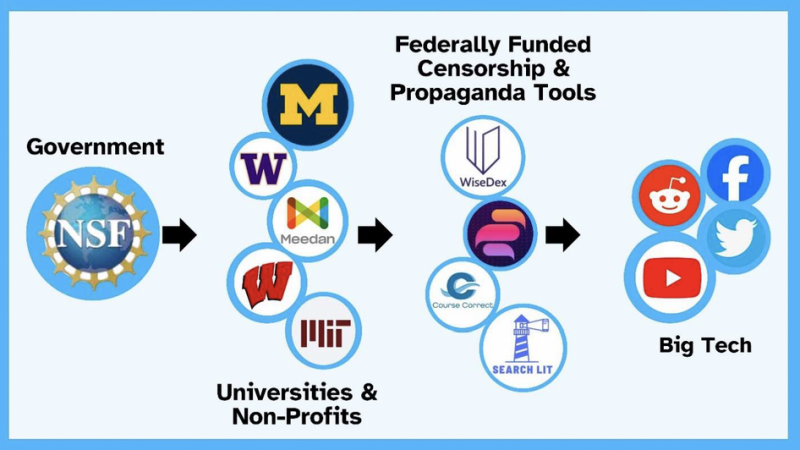

Hier ziet u hoe de relatie wordt gevisualiseerd in het rapport van de subcommissie:

Hier is een specifiek citaat uit het rapport van de subcommissie. Het komt uit “Speaker’s notes van de eerste pitch van de Universiteit van Michigan aan de National Science Foundation (NSF) over haar door NSF gefinancierde, AI-aangedreven WiseDex-tool.” De aantekeningen liggen ter inzage bij de commissie.

Onze desinformatiedienst helpt beleidsmakers op platforms die de verantwoordelijkheid voor moeilijke oordelen willen afschuiven op iemand buiten het bedrijf door de moeilijke verantwoordelijkheid van censuur te externaliseren.

Dit is een buitengewone uitspraak op zoveel niveaus:

- Het stelt ‘desinformatiedienst’ expliciet gelijk aan censuur.

Dit is een cruciale vergelijking, omdat regeringen over de hele wereld doen alsof ze schadelijke desinformatie bestrijden, terwijl dat in werkelijkheid het geval is het aannemen van enorme censuurwetten. De WEF verklaard ‘desinformatie en desinformatie’ de ‘ernstigste mondiale risico’s’ in de komende twee jaar, wat vermoedelijk betekent dat hun grootste inspanningen zullen gaan naar censuur.

Wanneer een overheidscontractant expliciet stelt dat hij een ‘misinformatiedienst’ verkoopt die onlineplatforms helpt ‘censuur te externaliseren’, wordt erkend dat de twee termen onderling uitwisselbaar zijn.

- Het verwijst naar censuur als een ‘verantwoordelijkheid’.

Met andere woorden, het gaat ervan uit dat een deel van wat de platforms zouden moeten doen censuur is. Kinderen niet beschermen tegen seksroofdieren of onschuldige burgers tegen desinformatie – gewoon duidelijke, onvervalste censuur.

- Er wordt gesteld dat de rol van AI erin bestaat de verantwoordelijkheid voor censuur te ‘externaliseren’.

De Tech-platforms willen geen censuurbeslissingen nemen. De overheid wil die besluiten nemen, maar wil niet als censuur worden gezien. Dankzij de AI-instrumenten kunnen de platforms de censuurbeslissingen ‘externaliseren’ en kan de overheid haar censuuractiviteiten verbergen.

Dit alles zou een einde moeten maken aan de illusie dat wat regeringen over de hele wereld ‘het tegengaan van desinformatie en haatzaaiende uitlatingen’ noemen, geen regelrechte censuur is.

Wat gebeurt er als AI-censuur volledig is geïmplementeerd?

Wetende dat de overheid al betaalt voor AI-censuurinstrumenten, moeten we ons afvragen wat dit inhoudt.

Geen mankrachtlimieten: Zoals het rapport van de Subcommissie aangeeft, hebben de grenzen aan de online censuur van de overheid tot nu toe te maken gehad met de grote aantallen mensen die eindeloze bestanden moesten doornemen en censuurbeslissingen moesten nemen. Bij AI hoeven er nauwelijks mensen bij betrokken te zijn, en de hoeveelheid gegevens die in de gaten gehouden kunnen worden kan zo groot zijn als alles wat iemand op een bepaald platform zegt. Die hoeveelheid gegevens is onbegrijpelijk voor een individueel menselijk brein.

Niemand is verantwoordelijk: Een van de meest beangstigende aspecten van AI-censuur is dat wanneer AI dit doet, er geen mens of organisatie is – of het nu de overheid, de platforms of de universiteit/non-profitorganisaties zijn – die feitelijk verantwoordelijk is voor de censuur. In eerste instantie geven mensen de AI-tool instructies over welke categorieën of typen taal moeten worden gecensureerd, maar daarna gaat de machine verder en neemt de beslissingen per geval helemaal zelf.

Geen verhaal bij klachten: Zodra AI wordt losgelaten met een reeks censuurinstructies, zal het miljarden online datapunten verzamelen en censuuracties toepassen. Als je een AI-censuuractie wilt betwisten, zul je met de machine moeten praten. Misschien zullen de platforms mensen in dienst nemen om op oproepen te reageren. Maar waarom zouden ze dat doen, als ze AI hebben die die reacties kan automatiseren?

Geen bescherming voor jongeren: Een van de beweringen van de overheidscensuur is dat we onze kinderen moeten beschermen tegen schadelijke online-informatie, zoals inhoud die hen anorexia maakt, hen aanmoedigt zelfmoord te plegen, hen in ISIS-terroristen verandert, enzovoort. Ook van seksuele uitbuiting. Dit zijn allemaal ernstige problemen die aandacht verdienen. Maar ze zijn lang niet zo gevaarlijk voor grote aantallen jonge mensen als AI-censuur.

Het gevaar van AI-censuur geldt voor alle jongeren die veel tijd online doorbrengen, omdat dit betekent dat hun online activiteiten en taalgebruik kunnen worden gevolgd en tegen hen kunnen worden gebruikt – misschien niet nu, maar telkens wanneer de overheid besluit achter een bepaald type aan te gaan van taal of gedrag. Dit is een veel groter gevaar voor een veel groter aantal kinderen dan het gevaar dat specifieke inhoud met zich meebrengt, omdat het alle activiteiten omvat die zij online ondernemen en bijna elk aspect van hun leven raakt.

Hier is een voorbeeld om dit gevaar te illustreren: Stel dat uw tiener veel interactieve videogames online speelt. Laten we zeggen dat hij een voorkeur heeft voor games die zijn ontworpen door Chinese bedrijven. Misschien kijkt hij ook toe hoe anderen die spellen spelen, en neemt hij deel aan chats en discussiegroepen over die spellen, waaraan ook veel Chinese staatsburgers deelnemen.

De regering zou volgende maand of volgend jaar kunnen besluiten dat iedereen die zich intensief bezighoudt met door China ontworpen videogames een gevaar voor de democratie is. Dit kan ertoe leiden dat de sociale media-accounts van uw zoon worden gesloten of dat hem de toegang tot financiële hulpmiddelen, zoals studieleningen, wordt ontzegd. Het kan ook inhouden dat hij op arbeids- of datingwebsites wordt gemarkeerd als gevaarlijk of ongewenst. Het kan betekenen dat hem een paspoort wordt geweigerd of dat hij op een volglijst wordt geplaatst.

Het leven van je tiener is een stuk moeilijker geworden. Veel moeilijker dan wanneer hij werd blootgesteld aan een rekruteringsvideo van ISIS of een zelfmoordverheerlijkende TikTok-post. En dit zou op veel grotere schaal gebeuren dan de seksuele uitbuiting waarvan de censuur gebruik maakt als Trojaans paard voor het normaliseren van het idee van online censuur door de overheid.

Censuurdiensten waarmee inkomsten kunnen worden gegenereerd: Een AI-tool die eigendom is van de overheid kan in theorie worden gebruikt door een niet-gouvernementele entiteit met toestemming van de overheid, en met de zegen van de platforms die de ‘verantwoordelijkheid’ voor censuur willen ‘externaliseren’. Dus hoewel de overheid AI zou kunnen gebruiken om bijvoorbeeld het anti-oorlogsgevoel te monitoren en te onderdrukken, zou een bedrijf het kunnen gebruiken om bijvoorbeeld het anti-fastfood-sentiment te monitoren en te onderdrukken. De overheid zou veel geld kunnen verdienen door de diensten van de AI-tools aan derden te verkopen. Het is ook denkbaar dat de platforms om een bezuiniging vragen. AI-censuurinstrumenten kunnen dus potentieel ten goede komen aan de overheid, technologieplatforms en particuliere bedrijven. De prikkels zijn zo krachtig dat het bijna onmogelijk is voor te stellen dat ze niet zullen worden uitgebuit.

Kunnen we de koers omkeren?

Ik weet niet hoeveel overheidsinstanties en hoeveel platforms AI-censuurtools gebruiken. Ik weet niet hoe snel ze kunnen opschalen.

Ik weet niet welke instrumenten we tot onze beschikking hebben – behalve het vergroten van het bewustzijn, het lobbyen bij politici en het aanspannen van rechtszaken om censuur door de overheid te voorkomen en het gebruik van AI-instrumenten op internet te reguleren.

Als iemand nog andere ideeën heeft, is dit het moment om deze uit te voeren.

Uitgegeven onder a Creative Commons Naamsvermelding 4.0 Internationale licentie

Stel voor herdrukken de canonieke link terug naar het origineel Brownstone Instituut Artikel en auteur.